Camera驱动 模组和硬件结构简介

2024年03月28日 Camera驱动 模组和硬件结构简介 极客笔记

Camera模组介绍,摄像头结构模组的图片如下:

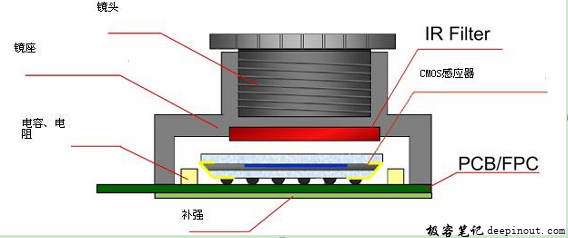

Camera模组主要由以下几部分组成:

工作原理

物体通过镜头(lens)聚集的光,通过CMOS或CCD集成电路,把光信号转换成电信号,再经过内部图像处理器(ISP)转换成数字图像信号输出到数字信号处理器(DSP)加工处理,转换成标准的GRB、YUV等格式图像信号。

CCM 包含四大件

镜头(lens)、传感器(sensor)、软板(FPC)、图像处理芯片(DSP)。

决定一个摄像头好坏的重要部件是:镜头(lens)、图像处理芯片 (DSP)、传感器(sensor)。

- 镜头(lens)是相机的灵魂,镜头(lens)对成像的效果有很重要的作用,是利用透镜的折射原理,景物光线通过镜头,在聚焦平面上形成清晰的影像,通过感光材料CMOS或CCD感光器记录景物的影像。

-

传感器(sensor)是CCM的核心模块,目前广泛使用的有两种:一种是广泛使用的CCD(电荷藕合)元件;另一种是CMOS(互补金属氧化物导体)器件。

-

图像处理芯片(DSP)是CCM的重要组成部分,它的作用是将感光芯片获得的数据及时快速地传递中央处理器并刷新感光芯片,因此DSP芯片的好坏,直接影响画面品质(比如色彩饱和度,清晰度等)。

图像的输出格式

YUV

“Y”表示明亮度(Luminance、Luma),“U”和“V”则是色度、浓度(Chrominance、Chroma), 一般情况下sensor支持YUV422格式,即数据格式是按Y-U-Y-V次序输出的。

JPEG

作为一种存储格式它是非常普遍的,但是作为sensor的输出格式的话,一般是低分辨率的,其自带JPEG engine,可以直接输出压缩后的jpg格式的数据;

RGB

传统的红绿蓝格式,比如RGB565.通俗点说它的颜色混合方式就好像有红、绿、蓝三盏灯,当它们的光相互叠合的时候,色彩相混,而亮度却等于两者亮度之总和,越混合亮度越高,即加法混合;

RAW

图像感应器将捕捉到的光源信号转化为数字信号的原始数据。RAW文件是一种记录了数码相机传感器的原始信息,同时记录了由相机拍摄所产生的一些原数据(Metadata,如ISO的设置、快门速度、光圈值、白平衡等)的文件。

RAW是未经处理、也未经压缩的格式,可以把RAW概念化为“原始图像编码数据”或更形象的称为“数字底片”。

不同的输出格式,包含的数据大小不同:

首先,如果说数据量最小,那么莫过于RAW格式,但是,数据传输过来要经过一次性大量的计算才能将里面的信息提取出来,如果你想用,一般5M以上sensor就只输出RAW数据以保证比较快的输出速度,后端挂一个DSP来处理输出的数据。其次是JPEG,数据量也很小,但是同样要求较快的处理速度。

而RGB和YUV一个像素都是占用了2B的大小,但是RGB却可以数据读出来直接刷到屏上,为什么要却要选择YUV的呢?原因在于YUV输出亮度信号没有任何损失,而色偏信号人眼并不是特别敏感,RGB565输出格式是R5G3 G3B5会丢掉很多原始信息,所以YUV图像质量和稳定性要比RGB565好的多。

传感器尺寸和画质的关系

传感器尺寸大小对于画质的影响,其实跟之前一样,就是采集的光线数据的正确性和完整性的不同。在像素相同的情况下:

- 传感器面积越大,感光阵列的面积就越大,相邻感光电路的距离就越大,加电时产生的电磁干扰就越小;

-

传感器面积越大,感光阵列的面积就越大,对应单个像素的透镜就能做的越大,聚集到的光线就越多,感光二极管受光后产生的输出电平就越高。假设噪声大小不变,那么更大的有用输出电平,带来更高的信噪比,转换后的信息处理时正确率就越高;

-

为什么在光线非常好的时候,传感器尺寸大小间的差异会缩小? 因为即使传感器尺寸小,但是光线强度足够,每个感光二极管都能受到足够的光线,产生的信噪比就大,噪点也就缩小了。

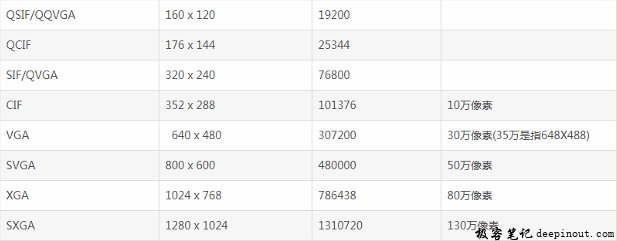

图像解析度/分辨率(Resolution)

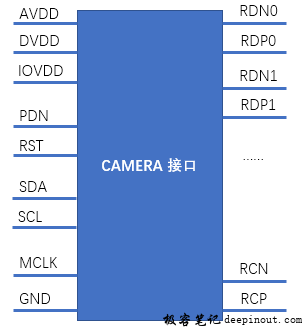

Camera硬件接口

camera的硬件接口如下图所示:

主要由如下五部分组成,协同工作:

- 三路电压AVDD/DVDD/IOVDD:

AVDD模拟电源,主要给感光区和ADC部分供电,要求比较干净;

DVDD数字电源,主要是给ISP的部分供电;

IOVDD数字IO电源,给I2C和 DVP部分供电。

- PDN/RST:

RST:用来reset sensor;RESET一般是低有效,当脉冲为低时,reset sensor,而正常工作时,应该为高。复位时序时序通常是: 高 –> 低 –> 高,根据硬件需要加一定的延时;

PWN:PWN一般高有效,当脉冲为高时,进入省电模式,而正常工作时为低。高电平时,一切对camera的操作都是无效的,包括复位。所以在RST之前,一定要将PWN管脚设置为正常工作模式,否则复位无效。

- I2C 控制接口SCL/SDA

-

MCLK 时钟用于分频给其他的clk使用;

-

mipi 接口RCP/RCN、RDP/RDN

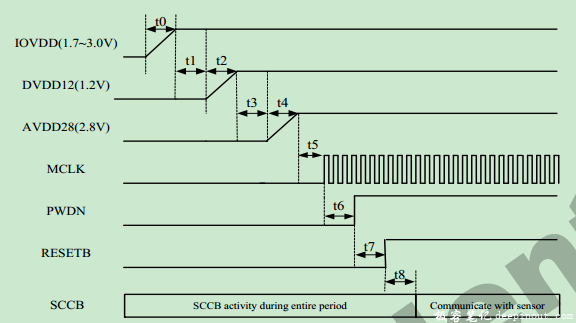

Camera 的工作时序

camera 工作时的上电时序,要完全按照datasheet上面的先后及时间间隔来:

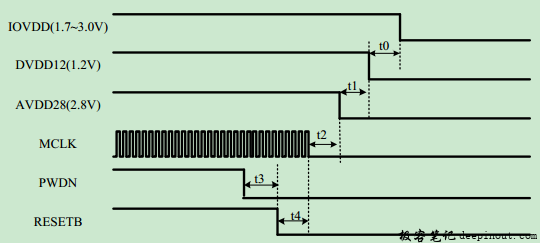

同样camera的下电时序也是一样:

本文链接:http://so.lmcjl.com/news/581/